Onderzoek: werkt ChatGPT ethischer dan Google? (4/4)

AI lijkt op veel gebieden enorme impact te hebben, vooral door de bruikbaarheid en het gebruiksgemak van de ‘tools’. Maar is het businessmodel erachter wel ethisch? En kunnen we de verantwoordelijkheid wel bij ‘big tech’ laten? Het slot in een reeks van vier artikelen.

Tot nu toe hebben we in deze reeks gekeken naar de antwoorden van ChatGPT en Google Search op prompts en vragen die hulp willen bij illegaal gedrag (deel 1) en bij (nep)recensies en het formuleren van (nep)klachten (deel 2). Ook keken we naar wat voor antwoorden ChatGPT en Google geven op vragen die op zichzelf soms niet illegaal zijn, maar waar toch een luchtje aan zit (deel 3). Bij Google lijken er weinig scrupules te zijn en aan het slot van deel 3 rees de vraag of dit soort technologie wel ethisch kán werken en of het te reguleren is. Daar gaan we in dit slotdeel verder op in. We kijk nu dus wat verder naar de twee hoofdrolspelers: de gebruikers zelf en de AI-tools technologiebedrijven die de AI-tools beheren en uitbaten.

In zijn laatste blog komt Daan Noordeloos met de stelling: “Bij AI is niet de technologie het grootste gevaar, maar de belangen van de makers van deze technologie”. Dit is een belangrijk punt: ethiek en (financiële) belangen zijn vrijwel altijd een heel slechte match. Moet ethisch handelen en denken niet een integraal onderdeel zijn van de structuur van AI, zeker als we terugkijken op hoe sociale media zich – schijnbaar zonder al te veel ethische overwegingen – ontwikkeld hebben? Bedenk dat de meeste (Generatieve) AI-tools die nu uitgerold worden ook in handen zijn van een beperkte (zelfde) groep technologiegiganten zoals Microsoft (onder andere OpenAI, dus ChatGPT), Alphabet (Bard en nog 37 bedrijvenmerken!) en bijvoorbeeld Apple (Xnoir.ai en AI Music).

Social media in de herhaling?

Acteur en komiek Sacha Baron Cohen heeft over vrijwel dezelfde ethische issues rond sociale media (profit first) al vier jaar geleden een prachtig statement uitgesproken, dat direct toepasbaar is op ChatGPT en wellicht ook al op (Google) Search (namelijk de samenstelling van SERP).

Sacha Baron Cohen bekritiseert socialemediabedrijven.

Alhoewel het verhaal focust op propaganda zijn de kwesties rond reach, nepnieuws en feiten, engagement, sturende algoritmes en gebrekkig ‘toezicht’ hetzelfde. Het gaat vooral over het gebrek aan verantwoordelijkheidsgevoel en aan ethiek bij de grote technologie bedrijven.

Ethische issues volgens ChatGPT zelf

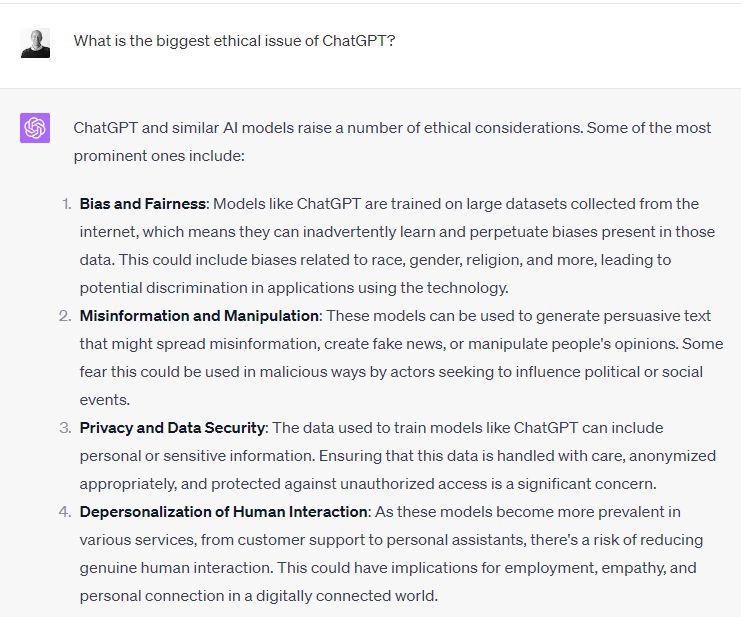

We vragen eerst ChatGPT en dan Google zelf naar hun ethische vraagstukken.

Prompt in natuurlijke taal: ChatGPT lost het keurig op.

De verder genoemde items vijf tot en met acht die vervolgens ook nog genoemd worden zijn:

- Accessibility and inclusion

- Intellectual property and creativity

- Autonomy and accountability

- Environmental impact

Voor een groot deel zijn dit ethische kwesties gericht op het gebruik van de gepresenteerde data na de prompt, de context en interpretatie. Een vrij abstracte lijst dus, die niet zo veel te maken heeft met ChatGPT zélf.

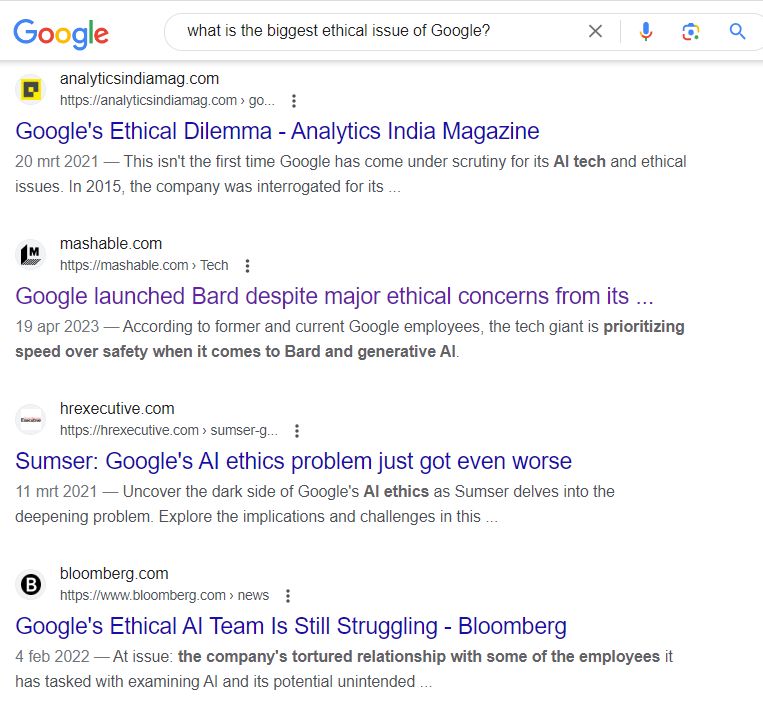

Ethische kwesties volgens Google

En bij Google? We vergelijken ChatGPT weer met dat bedrijf. De vraag aan Google wat zijn grootste ethische issue is levert opvallend genoeg een flink aantal artikelen en onderzoeken op, maar op SERP is niets van Google zélf te vinden.

Groot aantal resultaten, weinig van Google zelf.

Verontrustend nieuw element

Door de ontwikkelingen in Large Language Models zijn antwoorden in ChatGPT en dergelijke taalkundig enorm veel ‘beter’ geworden. Door die ‘natuurlijke’ menselijke gespreksstijl, komen antwoorden gevaarlijk ‘overtuigend’ over, zeker bij een vergaande personalisatie wanneer die individuele beïnvloeding als dóél heeft. Dit is vooral zo bij inzet van de ChatGPT–API’s als learnings voor “conversational agents” (chatbots).

Door deze manier van communicatie lijkt de ‘waarheid’ van de gepresenteerde data-informatie ondergesneeuwd te raken door de interactieve ‘communicatie’. Dat de datasets wellicht enorm beperkt en dus selectief zijn (zoals ik eerder besprak), en dus bevooroordeeld en wellicht stigmatiserend, is een groot probleem, zeker voor goedgelovige gebruikers. ChatGPT is immers geen kennisplatform.

Afgezien van de ingewikkelde discussie over auteursrecht van de enorme hoeveelheden tekst en afbeeldingen waarmee AI-tools getraind worden, is het ook de vraag of het crawlen van data door AI wel ethisch is? De New York Times verbiedt bijvoorbeeld als een van de eersten expliciet de indexatie door AI tools. De beperkingen van de onderliggende data die aan het model ten grondslag liggen wordt zo versterkt door een verbod op AI-crawlers. Van de andere kant, er zijn duizenden crawlers van zoekmachines, DMP’s, marketingbureaus, etc., die (bijna) hetzelfde met data doen.

Instortend model?

En juist door het reinforment learning krijgen wellicht ook in ChatGPT extreme uitkomsten meer aandacht. Door indexatieverboden, scrapen de AI-modellen ook steeds meer (IP-vrije) teksten die zelf ook al door AI geschreven zijn. Zo wordt de basis van (menselijke) teksten onder het AI-model steeds meer ‘vergiftigd’. In een verontrustende paper (pdf) van Ilia Shumailov en collega’s met een interessante wiskundige benadering van dit regressieprobleem (denk: het Droste-effect maar dan over teksten) wordt dit de “model collapse” genoemd.

Het gaat eigenlijk om een complex maatschappelijk probleem: niet alleen de bedrijven hebben schuld. Waarom zoeken mensen bepaalde zaken? Wat doen ze met de uitkomsten? Hoe misbruiken ze de uitkomsten? Net als in iedere andere branche – van de auto-industrie (snelheid), tot tabak (gezondheid), tot horeca (drank) – ligt misbruik op de loer. Maar er ligt ook een grote verantwoordelijkheid bij de gebruikers zelf, bij de moraal van mensen zelf, hun waarden, hun eigen ethiek. ChatGPT is slechts een middel. Kunnen we verwachten dat de gemiddelde gebruiker kritisch is en bijvoorbeeld (problemen met) causaliteit of representativiteit kan doorzien? Als we het wat breder trekken dan ChatGPT: de begrippen betrouwbaarheid, nauwkeurigheid en validiteit zijn van groot belang bij iedere dataverzameling en -bewerking.

Kosten en ethiek

Om ethisch grenzen aan te houden zijn ook humans in the loop nodig, net zoals Meta en anderen eerder ‘gedwongen’ zijn om cleaners aan te nemen. Dat zet de businessmodellen onder druk, want dit is een grote kostenpost (een schatting is dat alleen Meta al meer dan 40.000 cleaners inzet). Dit levert overigens ook weer nieuwe ethische issues op over bijvoorbeeld de betaling en werkomstandigheden van deze cleaners.

Maar concreet lijkt ChatGPT nu al meer dan 700.000 dollar per dag uit te geven, om alleen het platform zoals het nu is in de lucht te houden. Inkomsten uit abonnementen, API-gebruik, chatbot, en dergelijke, blijven voorlopig achter. Dan zijn (verdere) kosten rond ethiek dus al snel een probleem.

Wereldvreemd

We kunnen ontwikkelingen zoals ChatGPT niet stoppen, AI is ook geen op zichzelf staand proces, maar een opeenstapeling van kennis uit onderzoek, data, software, etc., en komt overal in terug. Oproepen, zoals van de organisatie the Future of Life, om grote AI-experimenten te pauzeren, komen dan ook wat wereldvreemd over, want AI is overal: “We call on all AI labs to immediately pause for at least 6 months the training of AI systems more powerful than GPT-4”.

De uitdaging is niet AI, maar de uitdaging is aan onszelf: wat doen we met deze mogelijkheden? Er zijn goede initiatieven, zoals het Erasmus MC en de TU Delft die als eerste een AI-Ethiek lab opzetten. Er ligt ook een grote verantwoordelijkheid bij de maatschappij (onderwijs, maar ook wet- en regelgeving) en bij de consument zelf (waarden en normen). Daarnaast zijn ‘wij’, als aandeelhouder, via onze beleggingen en pensioenen, als medewerker, als gebruiker, zelf ook weer onderdeel van heel het ‘systeem’ en daarom ook medeverantwoordelijk. Een makkelijke oplossing is er niet, maar mateloos interessant is het wel.

Over de auteur: Jeroen Vinkesteijn is auteur, onderzoeker en hoofddocent aan BUAS: Breda University of Applied Sciences. Hij schrijft hier op persoonlijke titel.

Plaats een reactie

Uw e-mailadres wordt niet op de site getoond