Zijn vrouwen kwaadaardig? Over de mindere kanten van algoritmes

Veel van onze vooroordelen zijn onbewust en daarom veelal onzichtbaar. En ze blijven onzichtbaar totdat we algoritmes maken, deze vullen met een hoop testdata en de uitkomsten bestuderen. Tijdens SXSW werd pijnlijk duidelijk wat algoritmes nog niet altijd politiek correct zijn.

De rol van vrouwen in onze maatschappij was een terugkerend onderwerp bij SXSW 2018. En niet alleen de gelijkheid der geslachten, elke vorm van gelijkheid was een populair onderwerp. Beroemdheden als Bernie Sanders, Bozoma Saint John (Chief Brand Officer bij Uber) of Margaret Stewart (VP of Design bij Facebook) omschreven uitgebreid dat zowel hun bedrijven als zijzelf vooral geloven in gelijke rechten voor iedereen.

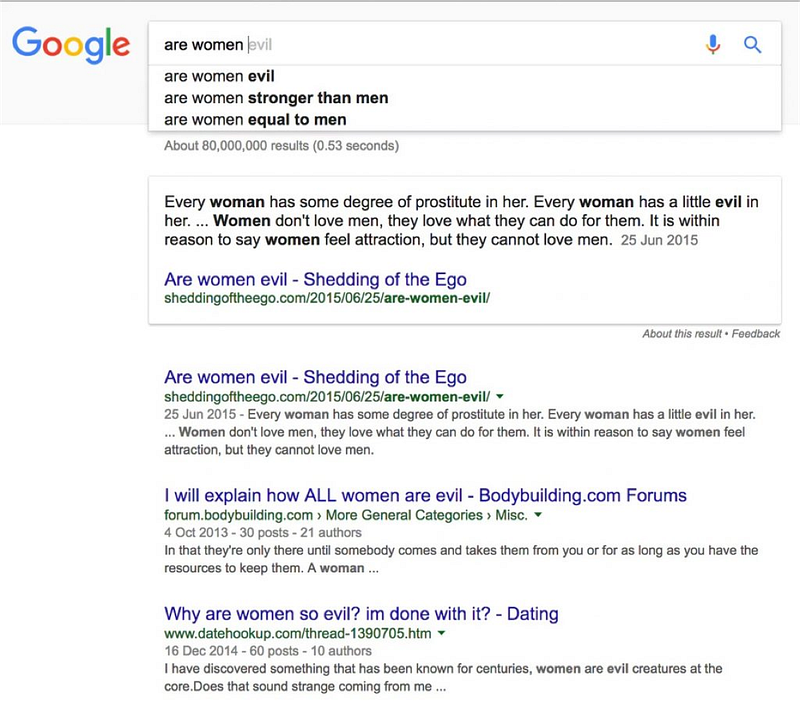

Helaas zijn veel van onze vooroordelen onbewust en daarom veelal onzichtbaar. En ze blijven onzichtbaar totdat we algoritmes maken, deze vullen met een hoop testdata en de uitkomsten bestuderen. Vaak komen onze onbewuste vooroordelen dan boven drijven. Dat dit pijnlijk kan zijn, illustreert de screenshot hierboven van de zoekopdracht naar “Are women…”

Algoritmes hebben het soms moeilijk met, op het oog, makkelijke taken.

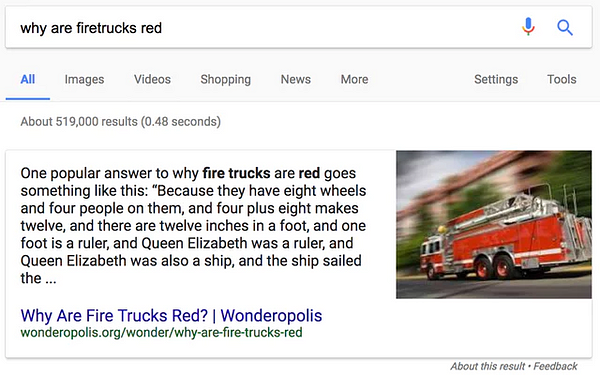

Josh Clark van Big Medium legt uit in zijn inspirerende presentatie dat het belangrijkste euvel van search algoritmes is dat ze altijd het antwoord presenteren, ook al weten ze het eigenlijk niet zo zeker. Het voorbeeld hierboven illustreert dit: op de vraag “Waarom zijn brandweerwagens rood?” geeft Google niet een goed antwoord, maar een flauw kindergrapje.

Onze eigen chatbot voor a.s.r. had ook wat opstartproblemen, maar zodra er genoeg testdata ingevoerd was schoot de NPS score omhoog.

Gelukkig biedt Josh ons 10 principes om op te letten wanneer we ontwerpen voor algoritmes:

- Nauwkeurigheid boven snelheid: soms is het beter een paar seconden langer te wachten. De huidige trend met veel smart home apparaten is dat het antwoord er vooral snel moet zijn, ten koste van de kwaliteit van het antwoord. Het zou moeten zijn: het beste antwoord ook al duurt dat wat langer. En ja, dat gaat soms ten koste van je search ranking.

- Onzekerheid is ok: maak systemen en algoritmes slim genoeg dat zodat ze weten dat ze niet slim genoeg zijn. Maak ze slim genoeg om hulp te vragen; om de gebruiker te melden dat ze het niet zeker weten; of dat ze meer input nodig hebben.

- Voeg de mens toe: Ontwerp een systeem dat een menselijk oordeel vraagt wanneer er onzekerheid is over de nauwkeurigheid van een antwoord; net als bij de Wikipedia pagina’s die gemarkeerd staan als disputed.

- Shit in shit out: de kwaliteit van een algoritme hangt sterk af van de test data dat erin gaat. Zorg ervoor dat deze zo objectief mogelijk is, zodat je niet voor verassingen komt te staan wanneer je zeeppompje het alleen doet bij blanke handen.

- Open data: Maak het je gebruikers gemakkelijk om data toe te voegen om het algoritme te verbeteren, maar zorg er ook voor dat ze eigenaarschap over deze data blijven behouden.

Laatste punt: wees aardig voor elkaar. Zorg ervoor dat machines geen keuzes voor ons maken. Of zoals Josh zegt: The future should not be self-driving.

p.s. Nee, vrouwen zijn niet kwaadaardig.

Plaats een reactie

Uw e-mailadres wordt niet op de site getoond